大数据开发 以Hadoop为基石的技术生态与实践

在当今信息爆炸的时代,大数据已从技术概念演变为驱动商业决策与科技创新的核心引擎。大数据开发,作为将海量、高速、多样的数据转化为价值的关键过程,其技术栈正日益丰富和成熟。而谈及大数据技术,Hadoop无疑是一座绕不开的里程碑,它奠定了分布式处理海量数据的理论基础与工程实践框架。

Hadoop:大数据处理的基石

Hadoop的核心设计思想源自Google的MapReduce和GFS论文,其核心组件包括:

- HDFS (Hadoop Distributed File System):一个高容错、高吞吐量的分布式文件系统,专为存储超大规模数据集而设计。它将文件分割成块,并分布式地存储在多台廉价服务器上,实现了数据的可靠存储与并行访问。

- MapReduce:一种编程模型,用于并行处理大规模数据集。它将计算任务分为两个阶段——“Map”(映射)阶段对数据进行过滤和排序,“Reduce”(归约)阶段对Map结果进行汇总。这种模型将计算任务分发到数据所在的节点,遵循“移动计算而非数据”的原则,极大地减少了网络传输开销。

正是HDFS与MapReduce的结合,使得企业能够利用普通的商用硬件集群来经济高效地处理PB乃至EB级的数据,解决了传统架构在可扩展性和成本上的瓶颈。

围绕Hadoop演进的丰富技术生态

随着应用场景的深化,Hadoop生态圈蓬勃发展,涌现出众多互补和增强的技术:

- 数据管理与计算引擎:

- Hive:基于Hadoop的数据仓库工具,提供类SQL(HQL)的查询功能,将复杂的MapReduce程序简化为熟悉的SQL语句,极大降低了数据分析的门槛。

- Spark:一个更快、更通用的集群计算系统。它通过内存计算和优化的执行引擎,在迭代计算和交互式查询上性能远超MapReduce,并提供了流处理(Spark Streaming)、图计算(GraphX)、机器学习(MLlib)等丰富库。

- Flink:主打流处理的下一代计算引擎,以其高吞吐、低延迟、精确一次(exactly-once)的状态一致性保证,在实时数据处理领域占据重要地位。

- 资源调度与管理:

- YARN (Yet Another Resource Negotiator):Hadoop 2.0引入的核心组件,它将资源管理与作业调度/监控分离,使Hadoop能够支持多种计算框架(如MapReduce, Spark, Flink)在同一个集群上运行,提高了集群利用率和多租户支持能力。

- 数据采集与传输:

- Flume:一个高可用的分布式海量日志采集、聚合和传输系统。

- Sqoop:用于在Hadoop和结构化数据存储(如关系型数据库)之间高效传输批量数据的工具。

- 协调与服务:

- ZooKeeper:一个分布式的、开放源码的分布式应用程序协调服务,提供配置维护、命名服务、分布式同步、组服务等,是许多大数据组件稳定运行的基础。

- 列式存储与查询:

- HBase:构建在HDFS之上的分布式、面向列的NoSQL数据库,适合实时读写和随机访问超大规模稀疏数据集。

大数据开发的核心工作与技能要求

一名大数据开发工程师的工作远不止于使用Hadoop。其核心职责通常包括:

- 数据管道构建:设计与开发稳定、高效的数据采集、清洗、转换、加载(ETL/ELT)流程,确保数据从源头到数据仓库/湖的顺畅流动。

- 数据仓库/湖建模:根据业务需求设计数据模型(如维度建模),构建层次清晰、易于访问和分析的数据体系。

- 计算任务开发:使用Spark、Flink等引擎编写复杂的批处理或流处理作业,实现业务逻辑,如用户画像、实时风控、推荐算法等。

- 性能优化:对数据倾斜、Shuffle过程、存储格式(如Parquet、ORC)、资源分配等进行调优,以提升任务执行效率和降低集群成本。

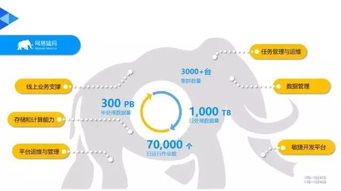

- 平台运维与监控:保障集群及各项服务的稳定运行,处理故障,并建立完善的监控告警体系。

所需的技能栈通常涵盖:扎实的Java/Scala/Python编程基础、对Hadoop生态各组件的深入理解、熟练使用Spark/Flink进行开发、熟悉Linux环境与Shell脚本、了解一种或多种SQL/NoSQL数据库,并具备良好的数据结构和算法基础。

与展望

Hadoop开启了大数据的工业化时代,但其生态已从单一的批处理范式,演进为批流一体、实时智能的融合架构。今天的大数据开发,是Hadoop基石与其繁荣生态共同编织的复杂画卷。随着云原生、数据湖仓一体(Lakehouse)、人工智能与机器学习更深度地融合,大数据开发的技术边界将持续拓展,但其核心目标始终如一:从数据的矿山中,更智能、更高效地提炼出洞察与价值。

如若转载,请注明出处:http://www.daowhy.com/product/275.html

更新时间:2026-06-03 21:13:50